Ce qui pourrait se traduire par le vol ou la fuite de secrets personnels ou d’entreprise

Un récent rapport de la société singapourienne de cybersécurité Group-IB indique que plus de 100 000 identifiants de comptes ChatGPT compromis se sont retrouvés en vente sur le dark Web. Ce vol de données a eu lieu entre juin 2022 et mai 2023, l’Inde représentant à elle seule 12 632 identifiants volés. Les identifiants ont été découverts dans des registres de logiciels malveillants de vol d’informations (stealer logs) mis en vente sur le dark Web. Le rapport conforte la position des entreprises qui ont interdit l’utilisation de ChatGPT à leurs employés en raison de préoccupations liées à des divulgations de données pouvant entraîner le vol de secrets commerciaux.

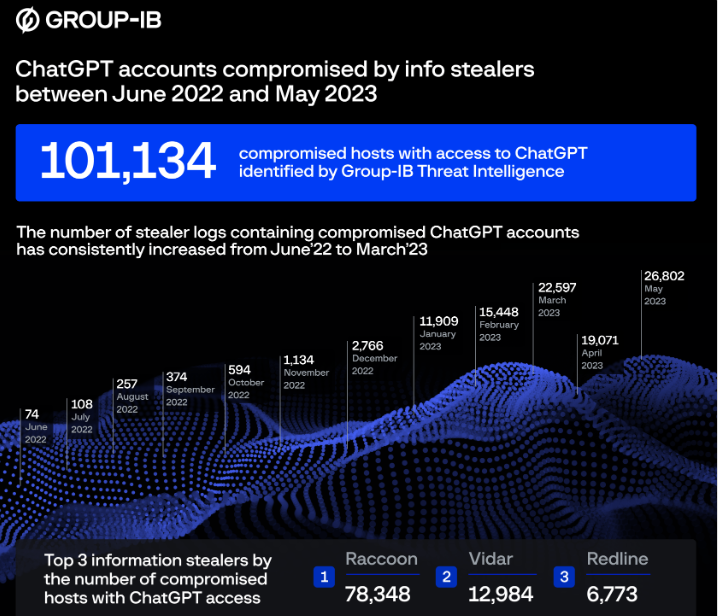

Le rapport de Group-IB est une nouvelle preuve attestant que les utilisateurs de ChatGPT doivent se méfier de la fuite de leurs données personnelles en ligne. OpenAI met en avant les mesures de sécurité qu’il a mises en place pour empêcher le vol et la divulgation des données personnelles des utilisateurs de ChatGPT, mais le rapport montre que le laboratoire d’IA de San Francisco doit faire plus d’efforts. Au total, Group-IB affirme avoir identifié 101 134 comptes d’accès à ChatGPT compromis et en vente sur les places de marché du dark Web. Selon l’entreprise de sécurité, ces informations d’identification auraient été volées entre juin 2022 à mai 2023.

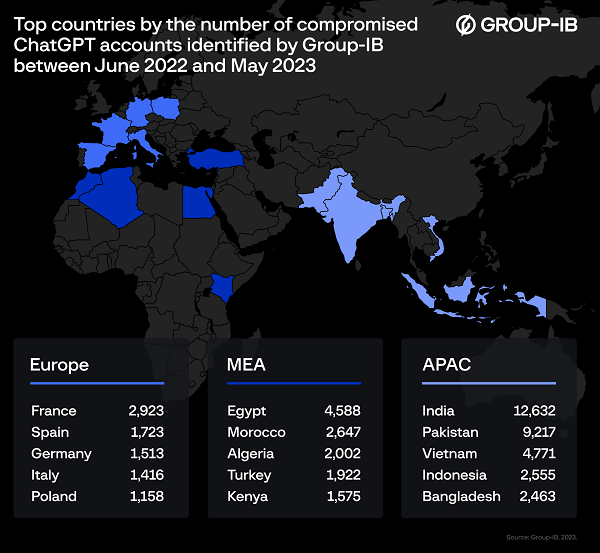

« Le nombre de journaux disponibles contenant des comptes ChatGPT compromis a atteint un pic de 26 802 en mai 2023. La région Asie-Pacifique a connu la plus forte concentration d’identifiants ChatGPT mis en vente au cours de l’année écoulée », a déclaré l’entreprise basée à Singapour. L’Inde représenterait à elle seule environ 12 632 identifiants volés. Les autres pays ayant le plus grand nombre d’identifiants ChatGPT compromis sont le Pakistan, le Brésil, le Vietnam, l’Égypte, les États-Unis, la France, le Maroc, l’Indonésie et le Bangladesh. En raison de l’adoption croissante de ChatGPT par les entreprises, Group-IB alerte sur le risque élevé de piratage.

Par défaut, ChatGPT stocke l’historique des requêtes des utilisateurs et les réponses du chatbot d’IA. Par conséquent, l’accès à l’historique pourrait révéler des secrets d’entreprise ou personnels. « Les experts de Group-IB soulignent que de plus en plus d’employés profitent du chatbot pour optimiser leur travail, qu’il s’agisse de développement de logiciels ou de communication d’entreprise. Et de nombreuses entreprises intègrent ChatGPT dans leur flux opérationnel. Les employés saisissent des correspondances classifiées ou utilisent le robot pour optimiser le code propriétaire », a déclaré Dmitry Shestakov, responsable de la veille sur les menaces au Group-IB.

Shestakov a ajouté que la demande d’identifiants de compte gagnait une popularité significative. En raison de ces risques, certaines entreprises ont banni l’utilisation de ChatGPT à leurs employés, notamment sur le lieu de travail ou sur les appareils électroniques fournis pour un usage professionnel. Par exemple, Apple et Samsung ont tous deux interdit l’utilisation de ChatGPT (ou n’importe quel autre chatbot) à leurs employés pour des raisons de sécurité. Dans le cas de Samsung, certains employés ont accidentellement divulgué des secrets. Selon les rapports, ces employés auraient commencé à utiliser ChatGPT pour corriger des erreurs dans leur code source.

Par ailleurs, le rapport indique qu’une analyse plus poussée a révélé que la majorité des journaux contenant des identifiants de comptes ChatGPT ont été violés par le célèbre voleur d’informations Raccoon (78 348), suivi par Vidar (12 984) et RedLine (6 773). Les logiciels malveillants de vol d’informations sont devenus populaires parmi les cybercriminels en raison de leur capacité à détourner les mots de passe, les cookies, les identifiants des cartes de crédit et d’autres informations des navigateurs, ainsi que les extensions de portefeuilles de cryptomonnaies. Selon Group-IB, il s’agit de l’un des programmes malveillants les plus utilisés aujourd’hui sur le Web.

Généralement proposés sur la base d’un modèle de tarification par abonnement, ils ont abaissé non seulement la barre de la cybercriminalité, mais servent également de canal pour lancer des attaques ultérieures à l’aide des informations d’identification siphonnées. « Les journaux contenant des informations compromises récoltées par les voleurs d’informations sont activement échangés sur les places de marché du dark Web. Des informations supplémentaires sur les journaux disponibles sur ces marchés comprennent les listes de domaines trouvés dans le journal ainsi que les informations sur l’adresse IP de l’hôte compromis », a déclaré Group-IB.

Pour atténuer les risques liés aux comptes ChatGPT compromis, Group-IB conseille aux utilisateurs de mettre à jour leurs mots de passe régulièrement et de mettre en œuvre l’authentification à deux facteurs (2FA). En activant le 2FA, les utilisateurs doivent fournir un code de vérification supplémentaire, généralement envoyé à leurs appareils mobiles, avant d’accéder à leurs comptes ChatGPT. En outre, en ce qui concerne les entreprises, Group-IB indique qu’avoir une visibilité sur les communautés du dark Web permet aux organisations d’identifier si leurs données sensibles ou les informations de leurs clients sont divulguées ou vendues.

« La veille sur les menaces en temps réel leur permet de prendre des mesures proactives pour atténuer l’impact, notifier les personnes concernées et renforcer leur dispositif de sécurité afin d’éviter d’autres dommages. Grâce à la veille sur les menaces en temps réel, les entreprises peuvent mieux comprendre le paysage des menaces, protéger leurs actifs de manière proactive et prendre des décisions éclairées pour renforcer leur position globale en matière de cybersécurité », a déclaré Group-IB.

source : 01net